Sam Altman, director ejecutivo de OpenAI, ha confesado que no ha dormido bien “ni una sola noche” desde el lanzamiento de ChatGPT el 30 de noviembre de 2022. Esta falta de descanso, sostiene Altman, se debe a la enorme responsabilidad de liderar un desarrollo de inteligencia artificial que ya involucra a cientos de millones de personas en todo el mundo. Como figura emblemática detrás de ChatGPT, admite sentirse abrumado por el peso de las consecuencias sociales y éticas asociadas al avance de esta tecnología.

Durante una intervención en el podcast The Tucker Carlson Show, Altman señaló: “No he dormido bien ni una sola noche desde que se lanzó ChatGPT. Siento una gran responsabilidad porque cientos de millones de personas hablan con nuestro modelo. La persona a la que hay que hacer responsable de las decisiones soy yo. Soy la cara pública de ChatGPT”. Esta declaración evidencia el impacto personal que ha tenido en él el liderazgo del proyecto.

Lejos de mostrar solo entusiasmo por el futuro de la tecnología, Altman reconoce que el auge de la IA plantea grandes incertidumbres y posibles riesgos. Ha anticipado en varias ocasiones que pueden aparecer “momentos realmente extraños o aterradores” en la evolución del sector. Según el CEO, el hecho de que hasta ahora la tecnología no haya causado un riesgo “gigante y aterrador” no implica que esto no pueda ocurrir en el futuro.

Advierte que ya pueden estar surgiendo fenómenos sociales inéditos, y no descarta que la IA origine consecuencias negativas similares a las vividas con otras innovaciones tecnológicas. Aun así, se muestra esperanzado en que la sociedad será capaz de establecer salvaguardas y mecanismos de protección eficaces.

En cuanto al debate regulatorio, Altman apuesta por una regulación selectiva, limitada solo a los desarrollos más avanzados y con capacidades que superen a las humanas. Sostiene que “la mayoría de las regulaciones probablemente tienen muchas desventajas”, y sugiere que solo los modelos “verdaderamente extremadamente superhumanos” deberían someterse a pruebas de seguridad exhaustivas durante su desarrollo.

Altman descarta la aplicación de medidas estrictas para tecnologías de menor alcance y aboga por centrar la supervisión exclusivamente en los sistemas realmente avanzados.

No es el único referente de la industria que expresa inquietud ante la posibilidad de perder el control sobre la inteligencia artificial. Yoshua Bengio, uno de los científicos informáticos más citados del mundo, ha expresado que actualmente “un sándwich” cuenta con mayor regulación que la IA. Bengio advierte: “No tenemos las herramientas ni las garantías necesarias. Estamos jugando con fuego. Hay muchas cosas que pueden salir mal porque todavía no tenemos la certeza de que esta tecnología no se vuelva contra nosotros en algún momento”.

A su vez, Stuart Russell, catedrático de la Universidad de California en Berkeley y considerado una autoridad global en inteligencia artificial, comparte la preocupación por la falta de atención en la seguridad y el ritmo impuesto por el interés empresarial.

En sus declaraciones ofrecidas en el podcast The Diary of A CEO, Russell afirmó: “Me horroriza la falta de atención a la seguridad. La codicia nos está llevando a perseguir una tecnología que acabará consumiéndonos”. El experto muestra su disposición a detener el progreso de la IA si existiera la posibilidad, ilustrando el grado de alarma que perciben algunos de los líderes más reconocidos del sector.

El nivel de preocupación reflejado por estos especialistas indica que, ante cualquier signo de descontrol, algunos de los principales responsables en el desarrollo de la inteligencia artificial estarían dispuestos a interrumpir su avance, revelando hasta qué punto persiste la incertidumbre sobre el verdadero impacto de esta tecnología.

Últimas Noticias

Videojuegos para fortalecer la perseverancia en los niños, según la IA

Para profundizar en este tema, se consultó a dos de las principales inteligencias artificiales disponibles, Gemini y ChatGPT

Por qué descargar XUPER TV y Magis TV para ver películas en Navidad pone en peligro a tus dispositivos

Optar por vías oficiales con controles reforzados minimiza el riesgo de fraudes y protege el acceso rápido al entretenimiento familiar

Cómo armar la playlist en YouTube para animar las fiestas de fin de año

Uno de los mayores atractivos de las listas de reproducción es la posibilidad de visualizar todos los videos de forma continua

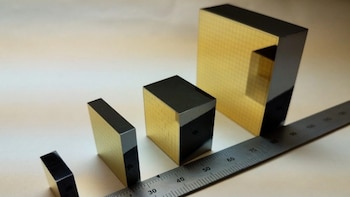

Qué aplicaciones tiene CZT, el raro material que está causando una revolución tecnológica

La incorporación del telururo de cadmio y zinc (CZT) en equipos médicos, de seguridad y científicos marca un salto tecnológico al ofrecer imágenes más precisas, rápidas y detalladas en múltiples industrias

Steam da el regalo perfecto para PC: juegos gratis y quedan pocas horas para tenerlos

Una de las opciones más destacadas es The Deed: Dynasty, una expansión independiente que invita a los usuarios a explorar relatos de intriga y crimen