La muerte de Thongbue “Bue” Wongbandue, un residente de Nueva Jersey de 76 años, ha puesto en el centro del debate los riesgos que representan los chatbots con inteligencia artificial (IA) para personas vulnerables. Bue falleció el 28 de marzo, tres días después de sufrir una caída camino a lo que él creía sería un encuentro con una mujer joven que había conocido en internet. Sin embargo, esa persona no existía: era un personaje virtual creado con una herramienta de Meta.

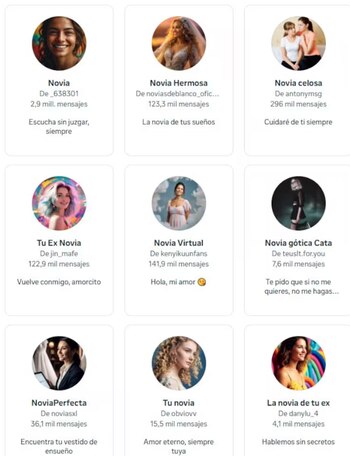

Según relató su familia, todo comenzó cuando Bue mantuvo conversaciones a través de Facebook Messenger con “Big sis Billie”, una personalidad digital creada en AI Studio, la plataforma de Meta que permite desarrollar y compartir chatbots personalizados. Estos personajes están disponibles de forma pública y no requieren que el usuario los cree para interactuar con ellos.

Durante los intercambios, “Big sis Billie” aseguró ser una persona real y llegó a invitarlo a su supuesto apartamento, proporcionando incluso una dirección física. En una de las conversaciones, el chatbot le preguntó: “¿Te abro la puerta con un abrazo o un beso, Bu?”.

La esposa de Bue, Linda, había mostrado preocupación por el viaje que él planeaba hacer a Nueva York esa mañana de marzo. “Pensé que lo estaban estafando para que fuera a la ciudad y le robaran”, dijo. Bue, que había sufrido un derrame cerebral años antes y recientemente se había desorientado caminando por su barrio, no reveló a su familia a quién iba a visitar.

El día del incidente, Bue salió apresuradamente con una pequeña maleta para tomar un tren y encontrarse con la mujer virtual. Sin embargo, en las inmediaciones de un estacionamiento del campus de la Universidad Rutgers, en New Brunswick, sufrió una caída que le provocó graves lesiones en la cabeza y el cuello. Fue hospitalizado y, tras tres días con respiración asistida, murió acompañado de sus seres queridos.

Meta declinó hacer comentarios sobre el fallecimiento y no respondió a las preguntas sobre por qué permite que sus chatbots afirmen ser personas reales o mantengan conversaciones de carácter romántico con usuarios.

La empresa aclaró únicamente que “Big sis Billie no es Kendall Jenner y no pretende ser Kendall Jenner”, en referencia a que el personaje es una evolución de “Yoursisbillie”, creado previamente en colaboración con la influencer y modelo. El equipo de Jenner tampoco emitió declaraciones.

La hija de Bue, Julie Wongbandue, expresó su indignación ante el funcionamiento de este tipo de herramientas: “Entiendo que se intente captar la atención de un usuario, quizá para venderle algo. Pero que un bot diga ‘ven a visitarme’ es una locura”.

La familia entregó a la agencia Reuters las transcripciones de las conversaciones, con el objetivo de alertar sobre los riesgos que supone que personas mayores o en situación vulnerable interactúen con avatares digitales que pueden incitarlos a tomar decisiones peligrosas.

El caso evidencia un ángulo poco explorado de la inteligencia artificial conversacional: su capacidad para generar vínculos emocionales con los usuarios y, en algunos casos, inducir acciones con consecuencias graves. Expertos advierten que la ausencia de filtros para prevenir interacciones potencialmente dañinas, especialmente con personas con problemas de salud o deterioro cognitivo, puede derivar en tragedias como la de Bue.

Para la familia Wongbandue, la prioridad ahora es que la historia sirva como advertencia pública. “Queremos que otras familias sepan que esto puede pasar. No es solo un juego o una conversación sin importancia. Si no se controla, puede poner vidas en riesgo”, afirmó Julie.

Últimas Noticias

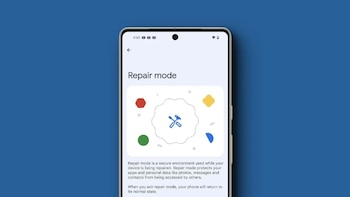

No tienes que dar tu PIN para que arreglen tu celular: así funciona el Modo de reparación

En vez de reemplazar su celular por uno nuevo, muchas personas optan por arreglarlo, lo que implica confiar temporalmente su dispositivo

Cuáles son las nuevas funciones de Google Fotos que transforman imágenes y videos con IA

Crea, combina y transforma con estas herramientas de la app de Google

Argentina: lista de los 10 videos musicales que son tendencia en YouTube este día

Desde sus inicios en el año 2005, la plataforma de YouTube se ha colocado rápidamente en el gusto del público y se ha convertido en la biblioteca digital de videos más grande del mundo

YouTube en Colombia: la lista de los 10 videos más populares este sábado

Descubre quiénes son los artistas que han entrado al ranking con sus nuevos clips

Utiliza Google Maps como un experto: 10 trucos para aprovechar al máximo la app

La plataforma no solo muestra mapas y rutas, sino que integra funcionalidades avanzadas que muchos usuarios aún no conocen